AI 에이전트 확산으로 작업당 토큰 사용량 5~30배 증가…고급 AI 수요가 비용 구조 재편

가트너(Gartner)가 2030년까지 1조 개(1000B) 파라미터를 가진 거대언어모델(LLM)의 추론 비용이 2025년 대비 90% 이상 감소할 것으로 전망했다. AI 토큰(AI Token)은 생성형 AI 모델이 처리하는 기본 데이터 단위로, 본 분석에서는 약 3.5바이트(약 4자)에 해당하는 데이터로 정의된다.

윌 소머(Will Sommer) 가트너 시니어 디렉터 애널리스트는 “이러한 비용 절감은 반도체 및 인프라 효율성 개선, 모델 설계 혁신, 칩 활용도 증가, 추론 특화 반도체 확대, 그리고 특정 활용 사례에서의 엣지 디바이스 적용 확대 등에 의해 가능해질 것”이라고 설명했다.

이러한 흐름에 따라 가트너는 2030년 LLM이 2022년 초기 동일 규모 모델 대비 최대 100배까지 비용 효율성이 개선될 것으로 내다봤다.

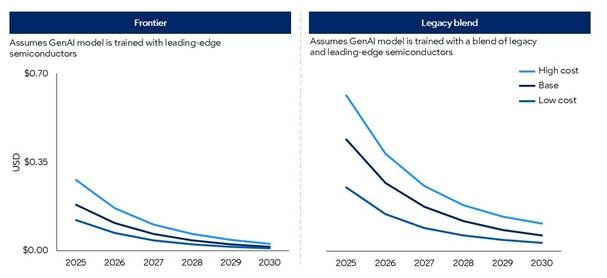

가트너는 이번 전망에서 두 가지 반도체 시나리오를 기반으로 비용을 분석했다.

· 프런티어(Frontier) 시나리오: 최첨단 반도체 기반 모델 처리

· 레거시 혼합(Legacy blend) 시나리오: 다양한 기존 반도체를 혼합 활용

혼합 시나리오는 연산 성능이 상대적으로 낮아 프런티어 시나리오 대비 비용이 상당히 높은 것으로 나타났다.

토큰 비용 하락에도 ‘AI 민주화’는 제한적

가트너는 토큰 단가 하락이 곧바로 기업의 AI 비용 절감으로 이어지지는 않을 것이라고 분석했다. 특히, 고도화된 AI 기능은 더 많은 토큰을 요구하는 구조적 특성을 갖는다. 예를 들어, AI에이전트는 기존 챗봇 대비 작업당 5배에서 최대 30배 더 많은 토큰을 필요로 하며, 수행 가능한 작업 범위도 훨씬 넓다. 이에 따라 토큰 단가는 하락하더라도, 토큰 사용량 증가 속도가 더 빠르기 때문에 전체 추론 비용은 오히려 증가할 것으로 예상된다는 것이다.

소머 애널리스트는 “제품 총괄 책임자(CPO)는 범용 토큰 가격 하락을 고급 추론 역량의 대중화로 오해해서는 안 된다”며, “기본적인 AI 기능은 사실상 제로 비용에 가까워지고 있지만, 고급 추론을 뒷받침하는 컴퓨팅 자원과 시스템은 여전히 희소하다”고 설명했다. 이어 “현재 저렴한 토큰 비용으로 아키텍처 비효율을 가리는 기업은, 향후 에이전트 기반 AI 확장 단계에서 한계에 직면하게 될 것”이라고 덧붙였다.

가트너는 다양한 모델 포트폴리오 전반에서 워크로드를 효율적으로 오케스트레이션할 수 있는 플랫폼에 가치가 집중될 것으로 전망했다. 반복적이고 빈도가 높은 업무는 보다 효율적인 소형 모델이나 도메인 특화 언어 모델로 처리해야 하며, 이러한 모델은 특정 워크플로에 맞게 활용될 경우 범용 모델 대비 훨씬 낮은 비용으로 더 나은 성능을 제공할 수 있다. 반면, 비용이 높은 프런티어급 모델의 추론은 엄격히 제한해 고부가가치의 복잡한 추론 작업에만 선택적으로 활용해야 한다는 설명이다.

<저작권자(c)스마트앤컴퍼니. 무단전재-재배포금지>