KAIST 전산학부 한준교수 연구팀, AI 인프라 보안 체계 강화...벽 너머 6m 거리에서도 AI 모델 구조 97.6% 정확도로 탈취

스마트폰 얼굴 인식부터 자율주행차까지, 인공지능(AI)은 ‘블랙박스’로 보호돼 왔다. 하지만 KAIST·국제 연구진이 벽 너머에서 AI의 ‘설계도’를 훔쳐볼 수 있는 새로운 보안 위협을 밝혀냈다. 대응 기술도 함께 제시했다. 향후 자율주행·의료·금융 등 다양한 분야에서 AI 보안을 강화하는 데 활용될 것으로 기대된다는 설명이다.

KAIST(총장 이광형) 전산학부 한준 교수 연구팀은 싱가포르국립대(NUS), 중국 저장대(Zhejiang University)와의 공동 연구를 통해 소형 안테나만으로 원거리에서 인공지능(AI) 모델 구조를 탈취할 수 있는 공격 시스템 ‘모델스파이(ModelSpy)’를 개발했다고 3월 31일 밝혔다.

이 기술은 마치 도청 장치처럼 인공지능이 작동할 때 발생하는 미세한 신호를 포착해 내부 구조를 분석하는 방식이다. 연구팀은 인공지능 연산을 담당하는 그래픽 처리 장치(GPU)에서 발생하는 전자기파에 주목했다. AI가 복잡한 연산을 수행할 때 GPU에서는 미세한 전자기 신호가 발생하는데, 연구팀은 이 신호의 패턴을 분석해 모델의 층 구성과 세부 설정값을 복원하는 데 성공했다는 것이다.

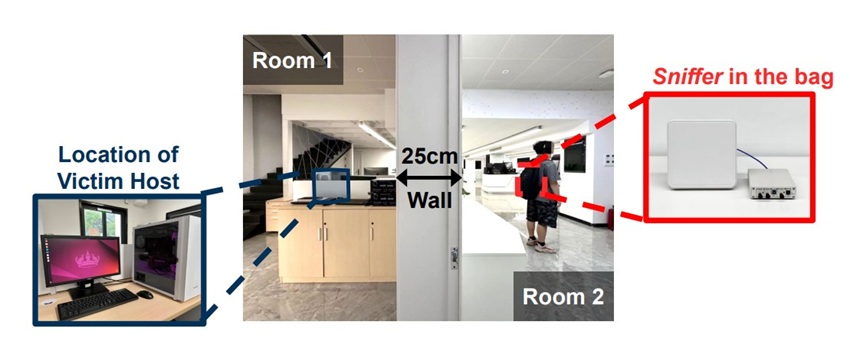

실험 결과, 최신 GPU 5종을 대상으로 벽 너머나 최대 6m 거리에서도 인공지능 모델 구조를 높은 정확도로 파악할 수 있었다. 특히 딥러닝 모델의 핵심 구조인 레이어를 최대 97.6%의 정확도로 추정했다.

이번 기술은 기존 해킹처럼 서버에 직접 침투하거나 악성코드를 설치할 필요 없이, 가방에 넣을 수 있는 소형 안테나만으로도 공격이 가능하다는 점에서 큰 보안 위협으로 평가된다.

연구팀은 이러한 기술이 악용될 경우 기업의 핵심 AI 자산이 외부로 유출될 수 있다고 보고, 전자기파 교란이나 연산 난독화 등 대응 기술도 함께 제시했다. 단순한 공격 시연을 넘어 현실적인 방어 방안을 제안했다는 점에서 책임 있는 보안 연구 사례로 평가된다.

한준 교수는 “이번 연구는 AI 시스템이 물리적 환경에서도 새로운 공격에 노출될 수 있음을 입증한 사례”라며, “자율주행이나 국가 기반 시설과 같은 중요한 AI 인프라를 보호하기 위해 하드웨어와 소프트웨어를 아우르는‘사이버-물리 보안’체계 구축이 중요하다”고 밝혔다.

이번 연구는 KAIST 전산학부 한준 교수가 공동 교신저자로 참여했으며, 컴퓨터 보안 분야 최고 권위 학술대회인 ‘NDSS(Network and Distributed System Security Symposium) 2026’에서 발표됐다. 또한 연구의 혁신성을 인정받아 최우수 논문상을 수상했다.

<저작권자(c)스마트앤컴퍼니. 무단전재-재배포금지>